Transcripción

¿Cómo funciona el reconocimiento de voz para transcribir un audio?

Con la introducción del habla a los programas de texto como Alexa, Cortana, Siri y el asistente de Google, el reconocimiento de voz comenzó a sustituir a la mecanografía como una forma de interactuar con nuestros dispositivos digitales.

¿En qué estado se encuentra actualmente la tecnología del reconocimiento de voz?

Los recientes avances tecnológicos en el área del reconocimiento del habla no sólo hicieron nuestra vida más cómoda y nuestro flujo de trabajo más productivo, sino que también abrieron oportunidades, que se consideraban «milagrosas» en aquellos tiempos.

El software encargado de transcribir audio a texto tiene una gran variedad de aplicaciones, y la lista sigue creciendo cada año. La atención sanitaria, la mejora del servicio al cliente, la investigación cualitativa, el periodismo, son sólo algunas de las industrias en las que la conversión de voz a texto ya se ha convertido en un importante recurso.

¿Para qué necesitamos la transcripción automática?

Los profesionales de diversas áreas necesitan transcripciones de alta calidad para realizar sus actividades laborales. La tecnología que subyace al reconocimiento de voz avanza a un ritmo rápido, lo que lo hace más rápido, más barato y más conveniente que la transcripción manual.

Aunque la tecnología aún no ha alcanzado el rendimiento humano, la precisión del software puede llegar al 95%. Los servicios de transcripción solían consumir mucho tiempo y mano de obra, mientras que ahora la participación humana en este proceso se limita a hacer pequeños ajustes.

Una razón más – Accesibilidad Digital

¿Por qué el reconocimiento automático del habla está actualmente en auge aquí en Europa? La respuesta es bastante simple: la accesibilidad digital. Como se describe en la Directiva de la UE 2016/2102, los gobiernos deben tomar medidas para asegurar que todos tengan el mismo acceso a la información. Los podcasts, videos y grabaciones de audio deben ser suministrados con subtítulos o transcripciones para que sean accesibles a las personas con discapacidades auditivas.

¿Cómo funciona el reconocimiento de voz automático?

P.D. – si es demasiado para leer en este momento, siéntete libre de saltar a la infografía resumida al final de esta página.

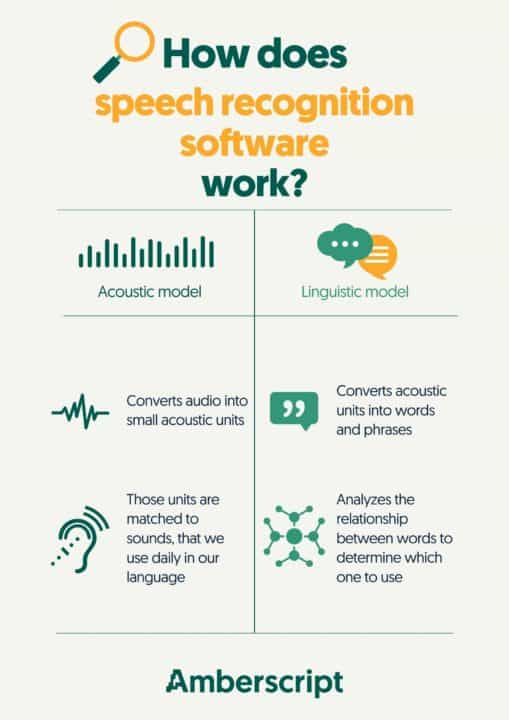

El núcleo de un servicio de transcripción automática es el sistema de reconocimiento automático del habla. En resumen, estos sistemas están compuestos por componentes acústicos y lingüísticos que funcionan en uno o varios ordenadores.

El componente acústico es responsable de convertir el audio de tu archivo en una secuencia de unidades acústicas – muestras de sonido súper pequeñas. ¿Has visto alguna vez una forma de onda del sonido? Eso es lo que llamamos sonido analógico o vibraciones que creas cuando hablas – se convierten en señales digitales, para que el software pueda analizarlas. Luego, las unidades acústicas mencionadas se emparejan con los «fonemas» existentes – esos son los sonidos que usamos en nuestro lenguaje para formar expresiones significativas.

A partir de entonces, el componente lingüístico se encarga de convertir esta secuencia de unidades acústicas en palabras, frases y párrafos. Hay muchas palabras que suenan similares, pero que significan cosas completamente diferentes, como «botar» y «votar».

El componente lingüístico analiza todas las palabras precedentes y su relación para estimar la probabilidad de qué palabra debe usarse a continuación. Los geeks los llaman «Modelos de Markov ocultos» – son ampliamente utilizados en todos los programas de reconocimiento de voz. Así es como los motores de reconocimiento de voz son capaces de determinar las partes de la oración y las terminaciones de las palabras.

Ejemplo: ellos escuchan un podcast. Aunque el sonido «n» de la palabra «escuchan» apenas se pronuncia, el componente lingüístico puede determinar que la palabra se escriba con «n», porque fue precedida por «ellos».

Puedes probarlo fácilmente en la vida real, como cualquier otra aplicación de voz, Google Translate tiene modelos de lenguaje detrás de él. Puedes escribir con la voz una palabra al azar que tenga varios significados, y luego proporcionarle al traductor un contexto (poniendo una palabra en una oración) – es muy probable que veas una transcripción y traducción más precisa.

Antes de poder utilizar un servicio de transcripción automática, estos componentes deben estar debidamente capacitados para comprender un idioma específico. Tanto la parte acústica de su contenido, es decir, cómo se está hablando y grabando, como la parte lingüística, es decir, lo que se está diciendo, son fundamentales para la precisión resultante de la transcripción.

Aquí en Amberscript, estamos constantemente mejorando nuestros componentes acústicos y lingüísticos para perfeccionar nuestro motor de reconocimiento de voz.

Sorpresa… ¡Hay un modelo más!

También hay algo llamado «modelo del interlocutor». El software de reconocimiento de voz puede ser dependiente o independiente del hablante.

El modelo dependiente del interlocutor está entrenado para una voz en particular, como la solución de voz a texto de Dragon. También puedes entrenar a Siri, Google y Cortana para que sólo reconozcan tu propia voz (en otras palabras, haces que el asistente de voz sea dependiente del interlocutor).

Por lo general, aporta una mayor precisión para un caso de uso particular, pero requiere tiempo para entrenar al modelo a entender tu voz. Además, el modelo dependiente del hablante no es flexible y no se puede utilizar de manera fiable en algunos entornos, como las conferencias.

Probablemente lo has adivinado – el modelo independiente de los interlocutores puede reconocer muchas voces diferentes sin ningún tipo de entrenamiento. Eso es lo que usamos actualmente en nuestro software en Amberscript.

¿Son todas las herramientas de reconocimiento de voz iguales?

¡No! Hay muchas herramientas dedicadas a transcribir audio a texto que sirven para diferentes propósitos. Algunas de ellas están diseñadas para tareas simples y repetitivas, otras son increíblemente avanzadas. Veamos los diferentes niveles de reconocimiento de voz.

1) ¿Llamaste alguna vez a una compañía, y luego el robot de voz te pidió que dejaras tu número de teléfono? Es la herramienta de reconocimiento de voz más simple, que trabaja en la coincidencia de patrones, tiene un vocabulario limitado, pero hace el trabajo (en este caso, entender los dígitos).

3) El último nivel de reconocimiento del habla se basa en redes neuronales artificiales, básicamente le da al motor la posibilidad de aprender y mejorar. El motor de Google, Microsoft y el nuestro está impulsado por el aprendizaje automático.

Software de discurso a texto. Expectativas vs. Realidad

Aunque en la última década la tecnología de reconocimiento de voz ha avanzado a un ritmo muy rápido, el software de voz a texto sigue planteando una serie de retos. Las limitaciones actuales del software de voz a texto son:

-Condiciones de grabación. El rendimiento de la transcripción humana y automatizada depende en gran medida de las condiciones de grabación. El software de reconocimiento de voz todavía lucha por interpretar el habla en un ambiente ruidoso o cuando muchas personas hablan al mismo tiempo.

P.D. – consulta nuestro post «Cómo mejorar la calidad de audio y optimizar la transcripción» para aprender algunos consejos prácticos que mejorarán la calidad de tu transcripción automática.

-Reconociendo ciertos dialectos y acentos. El lenguaje es una estructura compleja, y todos hablan de una manera ligeramente diferente. Una multitud de dialectos y acentos crean una complejidad adicional para el modelo. Sin embargo, esta complejidad puede ser manejada reuniendo diferentes tipos de datos.

-Entendiendo los homónimos. Los homónimos son palabras que suenan igual, pero difieren en significado y ortografía. Por ejemplo, «ola» (onda en el agua) y «hola» (saludo). La elección de la opción correcta requiere la comprensión del contexto. Aunque los modernos motores de voz a texto están impulsados por la IA, interpretar el contexto único de manera correcta sigue siendo difícil para las máquinas.

¿Qué hace que el motor de Amberscript sea tan preciso?

Se estima que nuestro motor alcanza una precisión de hasta el 95% – este nivel de calidad era previamente desconocido para el mercado holandés. Estaríamos más que contentos de compartir, de donde viene este rendimiento sin igual:

- Arquitectura y modelado inteligente. Estamos orgullosos de trabajar con un equipo de talentosos científicos del habla que desarrollaron un sofisticado modelo de lenguaje, que está abierto a la mejora continua.

- Grandes cantidades de material de entrenamiento. El software de voz a texto se basa en el aprendizaje automático. En otras palabras, cuantos más datos alimentes el sistema, mejor funcionará. Hemos recogido terabytes de datos en el camino para llegar a un nivel de calidad tan alto.

- Datos equilibrados. Con el fin de perfeccionar nuestro algoritmo, utilizamos varios tipos de datos. Nuestros especialistas obtuvieron un tamaño de muestra suficiente para ambos géneros, así como diferentes acentos y tonos de voz.

- Exploración de escenarios. Hemos probado nuestro modelo en varias condiciones acústicas para asegurar un rendimiento estable en diferentes escenarios de grabación.

Comprensión del Lenguaje Natural – El próximo gran tema en el reconocimiento de voz

Discutamos el próximo gran paso adelante para toda la industria, que es – la Comprensión del Lenguaje Natural (o CLN). Es una rama de la Inteligencia Artificial, que explora cómo las máquinas pueden entender e interpretar el lenguaje humano. La Comprensión del Lenguaje Natural permite que la tecnología de reconocimiento de voz no sólo transcriba el lenguaje humano, sino que también entienda el significado que hay detrás de él. En otras palabras, añadir algoritmos de CLN es como añadir un cerebro a un convertidor de voz a texto.

La CLN pretende afrontar el reto más difícil del reconocimiento de voz: comprender y trabajar con un contexto único.

¿Qué puedes hacer con la Comprensión del Lenguaje Natural?

-Traducción a máquina. Eso es algo que ya se está usando en Skype. Hablas en un idioma, y tu voz se transcribe automáticamente a un texto en otro idioma. Puedes tratarlo como el siguiente nivel de Google Translate. Esto por sí solo tiene un enorme potencial – sólo imagina lo fácil que se vuelve comunicarse con personas que no hablan tu idioma.

-Resumen de documentos. Vivimos en un mundo lleno de datos. Tal vez, hay demasiada información ahí fuera. Imagina tener un resumen instantáneo de un artículo, ensayo o un correo electrónico.

-Categorización del contenido. Al igual que en el punto anterior, el contenido puede ser reducido a temas o tópicos distintivos. Esta característica ya está implementada en los motores de búsqueda, como Google y YouTube.

-Análisis de los sentimientos. Esta técnica tiene como objetivo identificar las percepciones y opiniones humanas a través de un análisis sistemático de blogs, reseñas o incluso tweets. Esta práctica ya se aplica en muchas empresas, en particular las que trabajan en los medios de comunicación social.

¡Sí, nos dirigimos hacia allí! No sabemos si vamos a terminar en un mundo lleno de robots amistosos o en el de Matrix, pero las máquinas ya pueden entender las emociones humanas básicas.

-Detección de plagio. Las herramientas de plagio simples sólo comprueban si un contenido es una copia directa. Un software avanzado como Turnitin ya puede detectar si el mismo contenido fue parafraseado, haciendo la detección del plagio mucho más precisa.

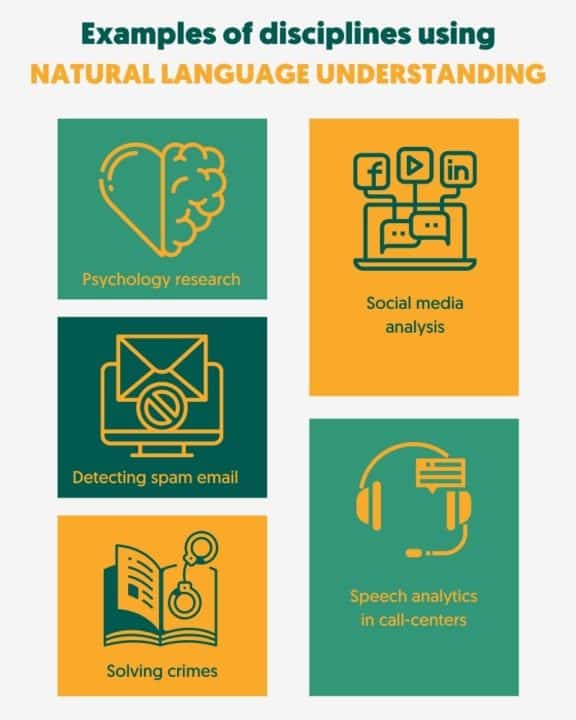

¿Dónde se aplica la CLN en estos días?

Hay muchas disciplinas en las que la CLN (como un subconjunto del Procesamiento del Lenguaje Natural) ya juega un papel importante. He aquí algunos ejemplos:

- Análisis de los medios sociales

- Investigación en psicología

- Detección de correo electrónico no deseado

- Usar lel análisis del dictado en los centros de llamadas

- Incluso… resolviendo crímenes

¿Qué es lo próximo??

Actualmente estamos integrando los algoritmos de la CLN en nuestros sistemas para hacer que nuestro software de reconocimiento de voz sea aún más inteligente y aplicable en una gama más amplia de aplicaciones.

¡Esperamos que ahora esté un poco más familiarizado con el fascinante campo del reconocimiento de voz! Siéntase libre de mirar nuestro blog para más lecturas interesantes como esta!